Oberseminar Winter 2014/15

| When and where: | Thu 4pm – 6pm, D-220 |

| Contact: | Prof. Dr. Frank Steinicke |

Inhalte

Das Oberseminar/Forschungskolloquium richtet sich an die BearbeiterInnen von Abschlussarbeiten, die Mitarbeiter und DoktorandInnen der MCI-Arbeitsgruppe sowie an alle MCI-Interessierte (und solche, die es werden wollen). Es wird in dieser Veranstaltung über aktuelle Projekte, Arbeitsergebnisse und Forschungsfragestellungen berichtet und diskutiert. Vortragende sind Mitglieder der MCI-Arbeitsgruppe, Studierende und externe Gäste. Die im Oberseminar/Forschungskolloquium vorgestellten Themen behandeln die Arbeiten der MCI-Arbeitsgruppe im Besonderen aber auch die Mensch-Computer-Interaktion in ihrer gesamten Breite. Die Veranstaltung bietet für alle an der Mensch-Computer-Interaktion Interessierte einen guten Überblick über die in der MCI-Arbeitsgruppe behandelten Themen und die dabei eingesetzten Methoden.

Vorgehen

Die Vortragsthemen werden vorab mit kurzer Inhaltsangabe im Web und über die MCI-News-Mailingliste bekannt gegeben. Spätestens eine Woche vor dem Vortragstermin schickt die/der Referent(in) dazu ein 1/2-seitiges Abstract und eine kurze Vita an Frank Steinicke (steinicke@informatik(steinicke"AT"informatik.uni-hamburg.de)...) und Julian Fietkau (julian.fietkau@informatik(julian.fietkau"AT"informatik.uni-hamburg.de)...).

QualifizierungsarbeiterInnen-Hinweis

Für die aktuellen MCI-Bachelor-, Master- und -DiplomarbeiterInnen ist der Besuch der Veranstaltung obligatorisch.

Termine:

- 29.01.2015: kein Termin

23.01.2015: Julian Fietkau (MSc) - Impacting the social presence of virtual agents by scaling the fidelity of their speech and movement

Virtual agents are constructs that fulfill human or human-like roles in virtual environments, but are directly controlled by software instead of real humans. They have use cases such as presenting information, demonstrationg actions or simulating a social environment. If a real person perceives them as sufficiently human-like, they may induce social phenomena like empathy, competition or conversational turn taking, even if the real person is consciously aware that the agent is purely virtual.

This thesis explores the influence of technical fidelity in terms of their speech and movement. Both of these two variables were assigned different implementations of varying technical sophistication, from text-to-speech output to fully recorded voices and from a completely rigid idle body to a high-quality relaxed idle animation based on motion capturing data. The various combinations were tested in an experiment using a head-mounted virtual reality display in order to measure their influence on perceived social presence. In this talk, I will describe the experiment and summarize its results.

Julian Fietkau has been a student in Hamburg since 2007. In that time, he has completed Bachelor's degrees in Informatics and Human-Computer Interaction and is now finishing up his Master's degree. He is specializing in HCI and has been active as a student assistant in HCI-related teaching and support work since 2010.

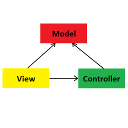

Henrik Stoldt (BSc) - Vergleichsanalyse verschiedener Programmierparadigmen für interaktive Systeme

In den letzten Jahrzehnten haben sich Informationssysteme stark verändert. Mit den ersten interaktiven Systemen standen die Entwickler vor neuen Problemen: Output und Input des Systems mussten gesteuert und koordiniert werden und gleichzeitig stieg die Größe der Softwareprojekte an. Als eine Lösung wurde 1979 das Programmierparadigma Model-View-Controller (MVC) entwickelt. Das MVC-Paradigma hat seitdem stark an Bedeutung gewonnen und gilt heutzutage als Standard. Doch über die Jahrzehnte sind aus dem Paradigma viele verschiedene MVC-Varianten hervorgegangen, die die Entwickler heutzutage vor die Qual der Wahl stellen. Ziel dieser Bachelorarbeit ist es, eine Übersicht der verschiedenen MVC-Programmierparadigmen zu bieten und sie hinsichtlich der praktischen Anwendungsfelder analysierend zu vergleichen. In diesem Zwischenstandsbericht wird das Thema, der aktuelle Stand sowie der weitere Vorgehensplan erläutert.

Henrik Stoldt studiert seit 2009 Informatik an der Universität Hamburg.

-

15.01.2015: Stephan Barnert (BSc) - Mensch-zentrierte Entwicklung einer Plattform zur Personalplanung

Heutzutage ist es üblich, dass ein Großteil aller Arbeitsaufgaben im Büro an Bildschirmarbeitsplätzen ausgeführt werden. Dies ist unabhängig davon, ob die Arbeit praktisch oder intellektuell gewichtet ist. Zur Verfügung stehen den Nutzern dabei generell zumindest Monitor, Maus und Tastatur. Um bei diesen EDV-Arbeitsplätzen eine effektive und ermüdungsfreie Bearbeitung der Aufgaben zu ermöglichen ist es besonders wichtig, die Arbeitsprozesse für die Nutzer so einfach und angenehm wie möglich zu gestalten. Bei der Bereitstellung von unterstützenden Technologien in Form von Hard- oder Software ist es daher von besonderer Bedeutung, den Benutzern auch ohne umfangreiche Anleitungen oder Beispiele begreiflich zu machen, wie mit der Technologie umzugehen ist. In diesem Kontext befasste sich die zugehörige Bachelorarbeit mit der mensch-zentrierten Entwicklung einer Applikation zur Personalplanung in Anlehnung an DIN EN ISO 9241.

Stephan Barnert studiert seit 2012 Wirtschaftsinformatik an der Universität Hamburg und hat 2014 sein Masterstudium zum IT-Management und Consulting begonnen.

Eike Langbehn (MSc) - Entwurf und Implementierung eines plattformübergreifenden Rahmenwerks zur Entwicklung von interaktiven 3D-Echtzeit-Anwendungen

Durch die steigende Verbreitung und zunehmende Leistungsfähigkeit von mobilen Betriebssystemen wie Android und iOS werden diese Plattformen auch für interaktive 3D-Anwendungen (Simulationen, Virtual Reality, Spiele etc.) immer interessanter. Daher werden Rahmenwerke benötigt, die es ermöglichen solche Anwendungen plattformunabhängig für mobile Systeme zu entwickeln. Die Herausforderung in der plattformübergreifenden Entwicklung für mobile Plattformen liegt dabei nicht nur in unterschiedlichen Hardware-Voraussetzungen und Prozessor-Architekturen, sondern ist vor allem durch restriktive Vorgaben der Hersteller begründet. Es wurde in der Masterarbeit ein plattformübergreifendes Rahmenwerk spezifiziert, entworfen und prototypisch implementiert, das Funktionen in den Bereichen 3D-Rendering, Physik-Simulation, Eingabe und GUI bereit stellt und die Anwendungsentwicklung für Android und iOS sowie diverse Desktop-Systeme (Windows, GNU/Linux, OS X) erlaubt. Darüber hinaus wurden mit dem Rahmenwerk drei Beispiel-Anwendungen aus unterschiedlichen Anwendungsdomänen implementiert, anhand denen das Rahmenwerk bewertet werden kann.

Eike Langbehn studierte in Oldenburg und Hamburg Informatik und erreichte im Dezember 2014 einen Masterabschluss. Inhaltlich beschäftigte er sich in seinem Studium vor allem mit Mensch-Computer-Interaktion und Computergrafik. Im Januar 2015 tritt er eine Stelle als Wissenschaftlicher Mitarbeiter am Arbeitsbereich Human-Computer Interaction der Universität Hamburg an.

-

08.01.2015: Dr. Benjamin Bolte (Institute of Psychology, University of Münster) - Decoupling Vision from Action - Redirected Walking and Rehabilitation in Immersive Virtual Environments

Immersive virtual environments enable users to experience virtual worlds. Although the experience can be very realistic and engaging, even todays immersive virtual environments are far from being optimal and face many issues that need to be solved. Perceptual differences, for instance, bias the perception of virtual environments. The available tracking space is often considerable smaller than the virtual world. Navigation techniques that enable users to quickly overcome large distances often introduce breaks in presence and have a negative influence on the user's spatial awareness. Despite the need for further improvements, immersive virtual environments already provide many benefits for various domains such as virtual rehabilitation.

In this talk I will present methods to address the aforementioned problems and to use the benefits of immersive virtual environments. First, the potential of complete geometric calibrations to alleviate distance underestimation in immersive virtual environments is explored. Second, the potential use of the perceptual phenomena of saccadic suppression of image displacement to reduce the required space for unnoticeable redirected walking is evaluated, which enables users to navigate through large virtual worlds within small physical spaces. Users are therefore reoriented and repositioned in the virtual world during saccades, since the human visual system usually fails to detect small trans-saccadic scene changes. Third, the jumper metaphor is introduced to make the exploration of large virtual environments more effective. To quickly overcome large distances, the user performs an accelerated movement such as a jump. Instead of an abrupt change of the user's position, a smooth transition is used to avoid negative effects on the user's spatial awareness. Finally, a virtual reality system to enhance the mobility of patients with chronic back pain is proposed. The aim of the system is to counteract typical changes of the motor system in these patients such as stiffness of the trunk. Virtual and real body rotations are therefore decoupled to induce increased back movements. Consequently, the task within the virtual world can be tailored to the patient's individual preferences and needs as long as body rotations are involved. For example, patients can be engaged in virtual movement games to additionally distract from pain and motivate the patients to move.

Benjamin Bolte has successfully completed his disputation to receive a PhD in Computer Science in December 2014 from the University of Münster. Between 2011 and 2014 he worked at the Institute of Psychology at the University of Münster. He received his diploma degree in Computer Science with minor in Biology and his diploma degree in Mathematics with the main focus on optimization and optimal control theory from the University of Münster in 2010.

18.12.2014: Oscar Javier Ariza Núñez (HCI) - Prototyping of interactive VR applications

In order to get usability results for a particular task using different hardware platforms and switching between different interaction techniques, the interaction designer should be able to create prototypes in a rapid and effective way. A graphic environment to design, configure and execute interactive VR applications is presented, focusing on particular concepts like prototyping and retargeting.

Oscar J. Ariza N. is a doctoral candidate at the Human-Computer Interaction Group of the Department of Informatics of the University of Hamburg. He finished his Master in Computer and Systems Engineering at Universidad de los Andes in Bogotá, Colombia and he graduated in Computer Engineering at Universidad Nacional de Colombia.

He is currently working as a research assistant in the project "Touching the Third Dimension" since November 2014.

- 11.12.2014: HCI Madness Session

- 04.12.2014: kein Termin

27.11.2014: Julian Schmid (BSc) - Gamification of E-Learning

This thesis explores the effectivity of video games to teach school materials on the example of fractional arithmetics. It aims to support the learning habits of students of secondary education by providing a learning method, with video games, that is fun and engaging for the students.

Learning games, which often aim to support students of primary education, allready exist. These often take a direct approach and require the students to solve gameplay puzzles, which are near identical to the tasks, that the students have to perform in tests. This thesis explores a more subtle approach and aims to increase the students basic understanding of the subject, instead of directly teaching the student how to solve a certain task.

To support the research of this thesis, a game was developed, which aims to teach students a basic understanding of fractional arithmetics. The game requires a player to divide a field into smaller fields of a certain size to provide seperate fields with enough space for various animals. This requires players to understand the size of various fractions and how they compare to other fractions.

The game was tested with at the Goethe Gymnasium in Hamburg with an experiment involving 27 participants. The participants seperated into two groups and first one group played the game, while the other learned with a book, then the first group learned with a book, while the second group played the game. Both groups were required to solve three tests, one before the start of the experiment, another one after the groups had learned or played once, and the last test at the end of the experiment.

The experiment was supported by an inquiry post-experiment similar to a focus group with the participants. The results suggest that the students gained a basic understanding of fractional arithmetics, although there were no enough significant results to draw a clear conclusion.

The thesis concludes that the project was successfull and that further research is required to gain a clear understanding of the effectivity of video games as a learning method in school of secondary education.

Julian Schmid is currently an university student working on his bachelor's degree in Informatics at the University of Hamburg.

Dr. Gerd Bruder (HCI) - Threefolded Motion Perception While Walking in Immersive Virtual Environments

Locomotion is one of the most fundamental processes in the real world, and its consideration in immersive virtual environments (IVEs) is of major importance for many application domains requiring immersive walkthroughs. From a simple physics perspective, such self-motion can be defined by the three components speed, distance, and time. Determining motions in the frame of reference of a human observer imposes a significant challenge to the perceptual processes in the human brain, and the resulting speed, distance, and time percepts are not always veridical. This talk covers experiments in an Oculus Rift head-mounted display (HMD) environment which showed that subjects largely underestimated virtual distances, slightly underestimated virtual speed, and slightly overestimated elapsed time.

Gerd Bruder is currently pursuing his Venia Legendi at the Department of Computer Science at the University of Hamburg. Between 2011 and 2014 he worked as a Post-Doc at the Department of Computer Science and the Department of Human-Computer-Media at the University of Würzburg. He received his diploma degree in Computer Science with a minor in Mathematics from the University of Münster in 2009. In 2011 he received his doctoral degree from the Department of Computer Science at the University of Münster.

His research is focused on human-computer interaction in computer-mediated realities with the aim of understanding human perception and action during (super-)natural interaction in three-dimensional environments. His research interests are creative technologies and techniques that can enable new exciting user experiences where computer-generated worlds meet the three dimensions we live in. He worked in several research projects, published in leading conferences and journals, and served as chair, reviewer, and committee member in various national and international conferences and workshops.

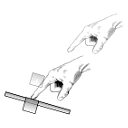

20.11.2014; Dr. Dimitar Valkov (VisCG, University of Münster) - Touching the Void: Touch interaction with stereoscopically rendered 3D objects

While touch technology has proven its usability for 2D interaction and has already become a standard input modality for many devices, the challenges to exploit its applicability with stereoscopically rendered content have barely been studied. In this talk we present different hardware and perception based techniques, which allow touching stereoscopically displayed objects when the input is constrained to a 2D surface. Approaches to handle this problem can roughly be separated into three groups: (1) approaches which separate the interactive and the visualization surfaces, such that the user can move the interactive surface and manipulate an object "in place"; (2) approaches which exploit the limitations of the human's visual system, i. e., which engage some visual illusions, such that the virtual scene is perceived and understood in 3D while the interaction tasks are carried out on a 2D surface and (3) approaches which shift the problem to the interface design space, i. e., which distinguish the "3D touch" as separate input modality with its own set of interaction techniques.

Since the third approach only partially solves the problem the talk mainly focuses on the first two options. Therefore we analyze the relation between the 3D positions of stereoscopically displayed objects and the on-surface touch points, where users touch the surface, and report the results of a series of experiments, which investigate the user's ability to discriminate small induced discrepancy between the perceived and felt point of contact and discuss their practical application.

Dimitar Valkov is currently a postdoctoral researcher in the Visualisation and Computer Graphics (VisCG) research Group at the University of Münster. He received his doctoral degree in 2014 and his diploma degree in Computer Science with a minor in Mathematics in 2009 from the Department of Computer Science at the University of Münster. He worked in several research projects, published in leading conferences, and served as committee member and reviewer in various international conferences and workshops.

13.11.2014: Jonas Schmid (BSc) - Augmentierung beliebiger Oberflächen mittels Multitouch Funktionalität

Das Erkennen von Berührungen bzw. Touchs auf beliebigen Oberflächen bildet eine Basis für neue User Interfaces. Um Berührungen auf Oberflächen zu erkennen, die nicht schon, wie z.B. kapazitive Multitouch-Displays, mit Sensoren bestückt sind, wurde in dieser Bachelorarbeit mit einem Infrarot-Tiefensensor (Microsoft Kinect 1) gearbeitet. Ziel der Bachelorarbeit war die Erarbeitung einer plattform-unabhängigen Software, die mit Hilfe der Daten des Tiefensensors Touchs erkennt und die Touch-Informationen mittels des "TUIO"-Protokoll an Client-Software verbreitet. Hierfür wurden einige Standard Computer-Vision Algorithmen wie z.B. "Background Subtraction", "Thresholding" und "Blob-Detection" verwendet. Der Vortrag wird einen Einblick in den Aufbau, die Funktionalität und die Beschränkungen des erarbeiteten Systems darstellen. Außerdem wird ein "Instant User Interface" zur Steuerung von VLC demonstriert.

Jonas Schmid studiert seit 2011 Mensch-Computer-Interaktion an der Universität Hamburg.

Christian Hagemann (BSc) - Performance-Analysis and KLM-Modelling for Xbox 360-Input-Controller

In the context of this work, a reaction time study to test users' performance on the Xbox 360 Controller was designed. A test was implemented and a study executed, to record participants' reaction times and mistakes for tasks performed with the controller. The participants were shown an image of the controller and then the action to perform was displayed in the image. The results are then described, analyzed and interpreted. In addition, the influence of this work on future game development will be discussed and design guidelines will be provided followed by possible upcoming research topics and examples from existing games.

Christian Hagemann studiert seit 2011 Mensch-Computer-Interaktion an der Universität Hamburg.

06.11.2014: Sabrina Hagemann (BSc) - Vergleichsanalyse von Editoren für Game-Engines zur Erstellung von texturierten Geländemodellen

Game-Engines sind die Basen vieler digitaler Spiele. Zu jeder Game-Engine gibt es einen eigenen Editor mit deren Hilfe die digitalen Spiele entwickelt werden. Ziel der Bachelorarbeit ist es festzustellen, wie diese Editoren im Allgemeinen aufgebaut sind und was verbessert werden kann, um die Gebrauchstauglichkeit und Performanz zu erhöhen. Um dies festzustellen, werden die Editoren der CryEngine, der NeoAxis 3D Engine, von Unity und der Unreal Engine im Aufbau der Benutzerschnittstellen und der Menüleisten miteinander verglichen und mithilfe von Keystroke-Level-Models und Gebrauchstauglichkeits-Heuristiken analysiert und verglichen.

Im Vortrag wird unter anderem die Erstellung eines texturiertes Geländemodell mit den vier Editoren zusehen sein und die dafür benötigten Zeiten werden mit den Zeiten der KLMs verglichen.

Sabrina Hagemann studiert seit 2012 Informatik an der Universität Hamburg.

Paul Lubos (HCI) - Comfortable 3DUI

Das Design von dreidimensionalen Userinterfaces ist ein schwieriges Thema. Bei der bisherigen Forschung im Bereich der 3DUIs lag der Fokus oftmals auf Performanz und weniger auf der komfortablen Nutzung dieser. Im Rahmen meiner Promotion beschäftige ich mich vor allem mit der komfortablen Interaktion mit virtuellen Welten. Unsere bisherigen Studien zeigen einen Einfluss von Komfort auf die Performanz von Nutzern, sowie einen signifikanten Einfluss der Position relativ zum Nutzer.

Paul Lubos schloss sein Masterstudium der Informatik an der Universität zu Münster im September 2013 ab und war bis zum März bei Prof. Dr. Frank Steinicke wissenschaftlicher Mitarbeiter an der Uni Würzburg. Er ist mit Prof. Steinicke zum ersten April zur Uni Hamburg gewechselt und hat das Ziel hier zu promovieren.

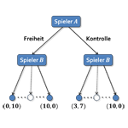

30.10.2014: Susanne Schmidt (HCI) - Entwicklung eines browserbasierten Online-Spiels für die experimentelle Wirtschaftsforschung

Für die Erforschung wirtschaftswissenschaftlicher Theorien haben sich in den letzten vier Jahrzehnten Experimente zu einem zentralen Werkzeug entwickelt. Klassische computerbasierte Experimente finden in speziellen Laboren statt, in denen die Experimentteilnehmer unter kontrollierten äußeren Bedingungen an getrennten PCs mit Entscheidungssituationen konfrontiert werden. Eine relativ neuartiger Ansatz in der experimentellen Wirtschaftsforschung basiert auf der Nutzung von Online-Spielen. Diese erfüllen natürlicherweise einige Grundvoraussetzungen für die Umsetzung ökonomischer Experimente, bringen jedoch auch gleichzeitig gewisse Einschränkungen mit sich. Die vorgestellte Masterarbeit beschäftigt sich mit einer Weiterentwicklung der computerspielbasierten Methode, welche die Vorzüge von Online-Spielen nutzt, ohne dabei auf die Einhaltung experimenteller Standards wie der Anonymität zwischen den Teilnehmern oder der finanziellen Vergütung zu verzichten.

Susanne Schmidt hat ihr Informatikstudium an der Technischen Universität Ilmenau absolviert, wo sie 2014 einen Masterabschluss erreichte. Schwerpunkte lagen dabei in den Bereichen Medieninformatik und Virtual Reality sowie Kognitiven Systemen. Seit August 2014 verstärkt sie das Team des Fachbereichs Mensch-Computer-Interaktion an der Universität Hamburg und strebt an dort zu promovieren.

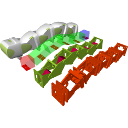

23.10.2014: Dennis Krupke (HCI / TAMS) - Modular Robots

Modulare Roboter sind trotz ihrer Einfachheit bzgl. ihres topologischen Aufbaus ein interessantes Gebiet der Informatik und Robotik. Die modulare Robotik bildet einen der wenigen Bereiche, in denen Grundlagenforschung noch notwendigerweise betrieben werden muss. Erst dann werden diese Roboter Einzug in den industriellen Bereich erhalten können. Es wurde ein Simulationssystem für modulare Roboter in raupen- und schlangenähnlichen Konfigurationen entwickelt, um Benutzer in Forschung und Lehre mit Handwerkszeug zur Entwicklung von Fortbewegungsalgorithmen auszustatten. Desweiteren wurde ein kostengünstiger modularer Roboter entwickelt, der leicht aus einigen 3D-gedruckten Teilen und Standardkomponenten zusammengebaut werden kann. Der Kreis der Entwicklungen schließt sich, da die 3D-Modelle für den Druck auch in dem Simulator zur Optimierung von Bewegungsparametern verwendet werden können.

Dennis Krupke schloss sein Diplomstudium der Informatik an der Universität Hamburg im September 2014 ab. 4 Jahre lang hat Dennis am Arbeitsbereich TAMS als studentische Hilfskraft an der Steuerung und Simulation modularer Roboter und der Optimierung ihrer Fortbewegungsmechanismen gearbeitet. In seiner derzeitigen Anstellung als wissenschaftlicher Mitarbeiter an den Arbeitsbereichen HCI und TAMS arbeitet er im Bereich Grasp-Prediction und Human-Robot-Interaction an seiner Promotion.

- 16.10.2014: Koordinationstreffen